前端

ftrace

PriorityQueue

调用

论文阅读

BeanMap

ffmpeg

深度信息

list

资源

汇编语言

语义分割

函数替换

mxnet

工业物联网

清华大学

cuda

taro

亿图图示

电磁

交叉熵损失

2024/4/13 17:36:59PyTorch基础——torch.nn.CrossEntropyLoss交叉熵损失

本文只考虑基本情况,未考虑加权。

torch.nnCrossEntropyLosss使用的公式 loss(x,class)−log(exp(x[class]∑jexp(x[j]))loss(x,class)-log(\frac {exp(x[class]} {\sum_jexp(x[j])}) loss(x,class)−log(∑jexp(x[j])exp(x[class])−x[class]log(∑jexp(x[j])…

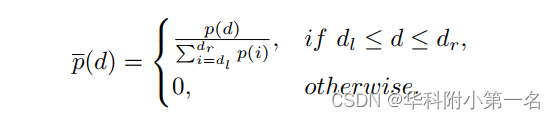

【论文简述】Rethinking Cross-Entropy Loss for Stereo Matching Networks(arxiv 2023)

一、论文简述

1. 第一作者:Peng Xu

2. 发表年份:2023

3. 发表期刊:arxiv

4. 关键词:立体匹配,交叉熵损失,过渡平滑和不对准问题,跨域泛化

5. 探索动机:立体匹配通常被认为是深度…

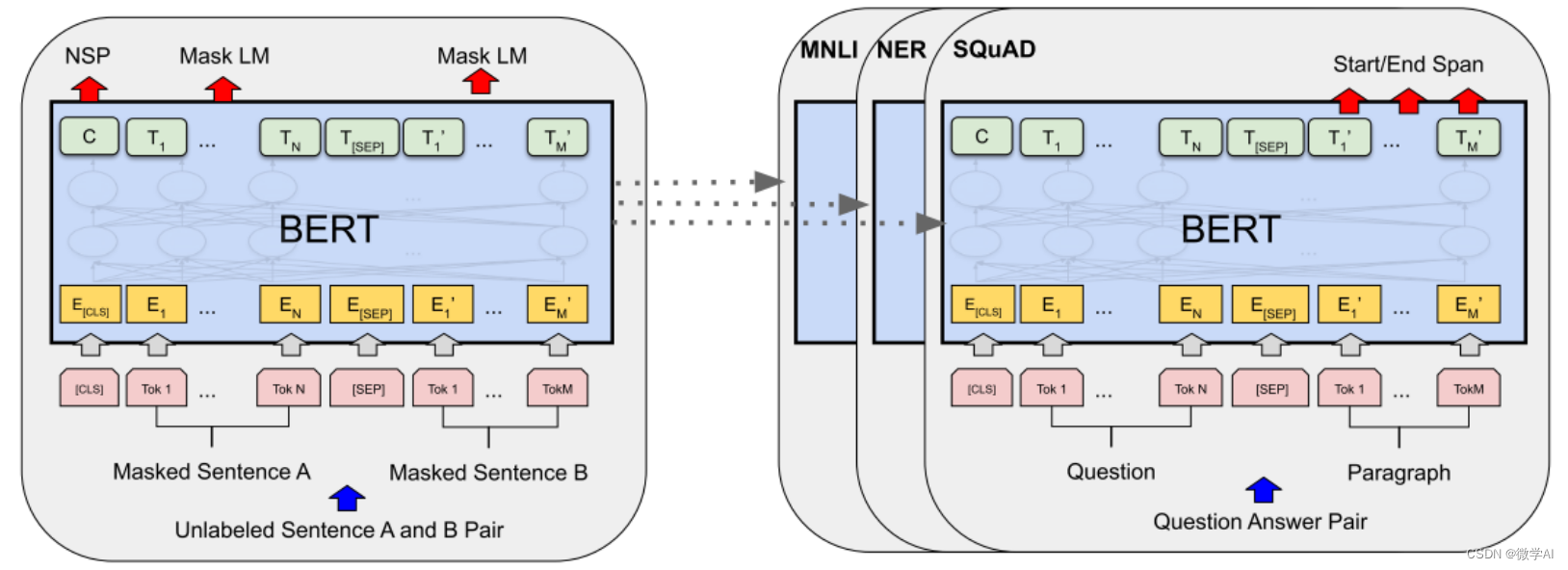

自然语言处理实战项目18-NLP模型训练中的Logits与损失函数的计算应用项目

大家好,我是微学AI,今天给大家介绍一下,自然语言处理实战项目18-NLP模型训练中的Logits与损失函数的计算应用项目,在NLP模型训练中,Logits常用于计算损失函数并进行优化。损失函数的计算是用来衡量模型预测结果与真实标签之间的差异,从而指导模型参数的更新。 Logits是模…

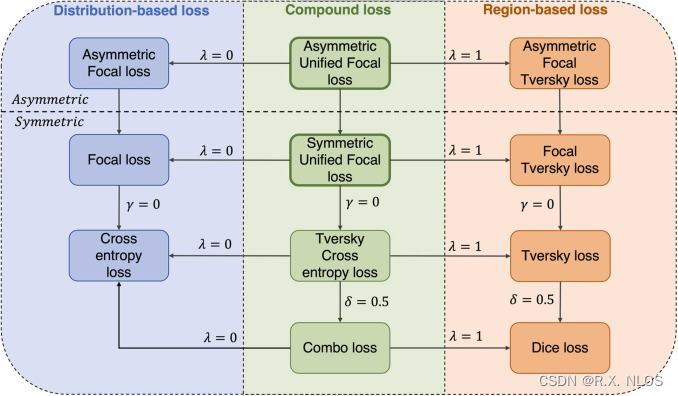

简要介绍 | 交叉熵损失:原理和研究现状

注1:本文系“简要介绍”系列之一,仅从概念上对交叉熵损失进行非常简要的介绍,不适合用于深入和详细的了解。 注2:"简要介绍"系列的所有创作均使用了AIGC工具辅助 交叉熵损失:原理、研究现状与未来展望 Under…